Что означает GPU?

GPU (Графический процессор видеокарты)

GPU (графический процессор) — высокотехнологическое устройство отвечающее за обработку графики в компьютерах, ноутбуках, мобильных телефонах. Современные GPU обладают специализированной конвейерной архитектурой, благодаря чему очень эффективно обрабатывают графическую информацию в сравнении с типичным центральным процессором. Может применяться как в составе дискретной видеокарты, так и в интегрированных решениях (встроенных в северный мост либо в гибридный процессор).

Основные отличия GPU от CPU:

- Архитектура (максимальный упор на обработку графических текстур)

- Ограниченный набор исполнительных команд

Высокая скорость и мощность процессоров GPU на данное время объясняется особенностями архитектуры построения. Если современные CPU состоят из 2-6 ядер, то GPU считается многоядерной структурой, использующей сразу до сотни ядер. CPU предполагает обработку информации последовательно, а GPU рассчитан на многопотоковую параллельную работу с массивом информации.

windows-gadjet.ru

Отличие CPU и GPU

Графический процессор может выполнить лишь часть операций, которые может выполнить центральный процессор, но он делает это с невероятной скоростью. GPU будет использовать сотни ядер, чтобы выполнить срочные вычисления для тысяч пикселей и отобразить при этом сложную 3D графику. Но для достижения высоких скоростей GPU должен выполнять однообразные операции.

Возьмем, например, Nvidia GTX 1080. Данная видеокарта имеет 2560 шейдерных ядер. Благодаря этим ядрам Nvidia GTX 1080 может выполнить 2560 инструкций или операций за один такт. Если вы захотите сделать картинку на 1% ярче, то GPU с этим справится без особого труда. А вот четырехъядерный центральный процессор Intel Core i5 сможет выполнить только 4 инструкции за один такт.

Тем не менее, центральные процессоры более гибкие, чем графические. Центральные процессоры имеют больший набор инструкций, поэтому они могут выполнять более широкий диапазон функций. Также CPU работают на более высоких максимальных тактовых частотах и имеют возможность управлять вводом и выводом компонентов компьютера. Например, центральный процессор может интегрироваться с виртуальной памятью, которая необходима для запуска современной операционной системы. Это как раз то, что графический процессор выполнить не сможет.

Температура GPU

GPU является один из самых горячих компонентов компьютера. Как и центральный процессор, GPU выделяет много тепла и его нужно эффективно отводить. Иначе графический процессор начнет перегреваться, что приведет к снижению производительности, сбоям в работе, перегрузкам компьютера и даже поломке.

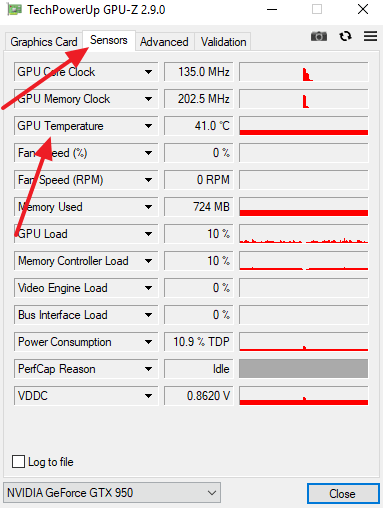

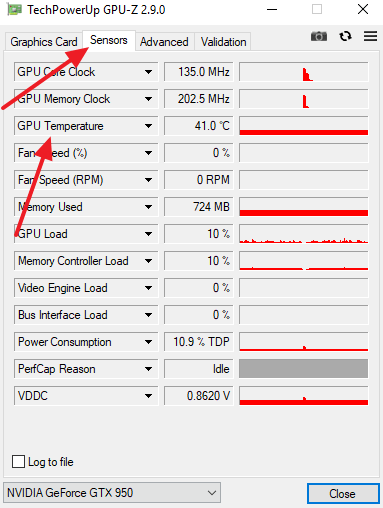

Узнать температуру GPU можно с помощью специальных программ. Например, можно использовать , которую мы уже вспоминали. Если в программе GPU-Z перейти на вкладку «Sensors», то можно получить информацию о текучем состоянии видеокарты. Здесь будет указана частота GPU, его загрузка, температура и другие параметры.

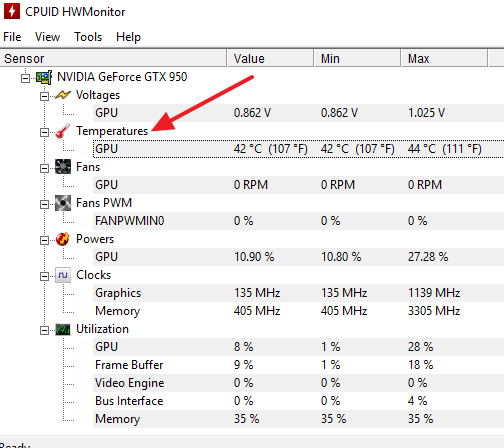

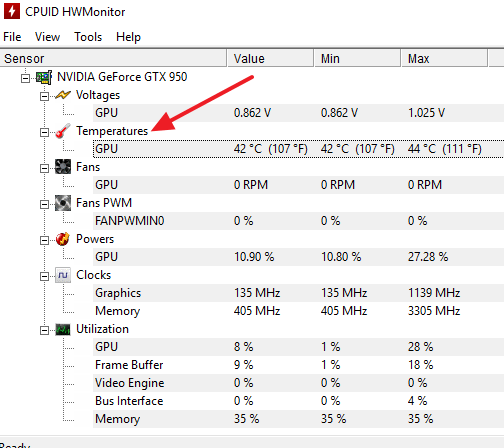

Если вы хотите проверить не только температуру GPU, но и температуры других компонентов компьютера, то для этого удобно пользоваться программой . Данная программа отображает температуру, частоты, загрузку и другие параметры сразу для всех компонентов.

После проверки температуры часто возникает вопрос, . Точного ответа на этот вопрос нет, поскольку у разных GPU разный предел температур, которые они могут переносить без последствий. Но, в среднем нормальной температурой графического процессора является

:

- до 55 °C в режиме простоя;

- до 80 °C под нагрузкой;

Если температура вашего GPU выходит за эти пределы, то это можно считать перегревом. В таком случае нужно улучшить охлаждение графического чипа, для того чтобы привести эти значения к норме.

Если нужно , то стоит начать с удаления пыли, которая скопилась на ее радиаторе. Если радиатор сильно забит пылью, то это может повышать температуру графического процессора на 5-10 градусов. Если простая чистка радиатора не помогает, то нужно заменить термопасту. В крайнем случае можно улучшить продуваемость корпуса компьютера, добавив несколько вентиляторов на вдув и выдув воздуха.

Процессоры и графические ускорители очень похожи, они оба сделаны из сотен миллионов транзисторов и могут обрабатывать тысячи операций за секунду. Но чем именно отличаются эти два важных компонента любого домашнего компьютера?

В данной статье мы попытаемся очень просто и доступно рассказать, в чем отличие CPU от GPU. Но сначала нужно рассмотреть два этих процессора по отдельности.

CPU (Central Processing Unit или же Центральное Процессорное Устройство) часто называют «мозгом» компьютера. Внутри центрального процессора расположено около миллиона транзисторов, с помощью которых производятся различные вычисления. В домашних компьютерах обычно устанавливаются процессоры, имеющие от 1 до 4 ядер с тактовой частотой приблизительно от 1 ГГц до 4 ГГц.

Процессор является мощным, потому что может делать все. Компьютер способен выполнить какую-либо задачу, так как процессор способен выполнить эту задачу. Программистам удалось достичь этого благодаря широким наборам инструкций и огромным спискам функций, совместно используемых в современных центральных процессорах.

Что делать, если видеокарта перегревается

Часто активные пользователи компьютера не обращают внимание на перегрев комплектующих, что собственно приводит к последствиям. Поэтому однозначно всегда стоит использовать программы для мониторинга температуры видеокарты и процессора

Если же отвечать на вопрос, что делать, если видеокарта перегревается, то здесь всё просто, как и в случае с процессором следует:

- проверить работу охлаждения видеокарты (при необходимости почистить от пыли, поскольку эта проблема очень часто встречается);

- заменить термопасту (очистив остатки засохшей ранее термопасты и тонким слоем нанести новую);

- настроить правильную циркуляцию воздуха в корпусе (тёплый воздух должен выходить с корпуса компьютера, а холодный заходить).

Если же после проведённых операций рабочая температура не вернулась в норму, тогда следует задуматься о замене системы охлаждения в целом поскольку, скорее всего, она уже не справляется с поставленной задачей.

Заключение

С помощью стороннего программного обеспечения несложно узнать температуру видеокарты в Windows 10. Все программы для мониторинга температуры видеокарт хорошо справляются со своей задачей. Мы отдаём предпочтение многофункциональной утилите TechPowerUp GPU-Z.

Выбор всё же остаётся за Вами. А также напишите нам, как Вы проверяете температуру комплектующих или каким программам отдаёте предпочтение. И необязательно делать выбор только исходя из списка выше. Есть множество других и не менее функциональных утилит.

Вместо заключения

Рост рынка графических процессоров обеспечивается возрастающим интересом к возможностям таких устройств. GPU применяется в домашних игровых системах, задачах рендеринга и видеообработки, а также там, где требуются общие высокопроизводительные вычисления. Практическое применение задач интеллектуального анализа данных будет проникать все глубже в нашу повседневную жизнь. И выполнение подобных программ наиболее эффективно осуществляется именно с помощью GPU.

Мы благодарим наших клиентов, а также преподавателей и студентов Школы анализа данных за совместную подготовку материала, и приглашаем наших читателей познакомиться с ними поближе .

А опытным и искушенным в сфере машинного обучения, анализа данных и не только мы предлагаем посмотреть от Selectel по аренде серверного оборудования с графическми ускорителями: от простых GTX 1080 до Tesla P100 и K80 для самых требовательных задач.

Эпоха GPU

Для начала вспомним, что же такое GPU. Graphics Processing Unit — это графический процессор широко используемый в настольных и серверных системах. Отличительной особенностью этого устройства является ориентированность на массовые параллельные вычисления. В отличие от графических процессоров архитектура другого вычислительного модуля CPU (Central Processor Unit) предназначена для последовательной обработки данных. Если количество ядер в обычном CPU измеряется десятками, то в GPU их счет идет на тысячи, что накладывает ограничения на типы выполняемых команд, однако обеспечивает высокую вычислительную производительность в задачах, включающих параллелизм.

Первые шаги

Развитие видеопроцессоров на ранних этапах было тесно связано с нарастающей потребностью в отдельном вычислительном устройстве для обработки двух и трехмерной графики. До появления отдельных схем видеоконтроллеров в 70-х годах вывод изображения осуществлялся через использование дискретной логики, что сказывалось на увеличенном энергопотреблении и больших размерах печатных плат. Специализированные микросхемы позволили выделить разработку устройств, предназначенных для работы с графикой, в отдельное направление.

Следующим революционным событием стало появление нового класса более сложных и многофункциональных устройств — видеопроцессоров. В 1996 году компания 3dfx Interactive выпустила чипсет Voodoo Graphics, который быстро занял 85% рынка специализированных видеоустройств и стал лидером в области 3D графики того времени. После серии неудачных решений менеджмента компании, среди которых была покупка производителя видеокарт STB, 3dfx уступила первенство NVIDIA и ATI (позднее AMD), а в 2002 объявила о своем банкротстве.

Общие вычисления на GPU

В 2006 году NVIDIA объявила о выпуске линейки продуктов GeForce 8 series, которая положила начало новому классу устройств, предназначенных для общих вычислений на графических процессорах (GPGPU). В ходе разработки NVIDIA пришла к пониманию, что большее число ядер, работающих на меньшей частоте, более эффективны для параллельных нагрузок, чем малое число более производительных ядер. Видеопроцессоры нового поколения обеспечили поддержку параллельных вычислений не только для обработки видеопотоков, но также для проблем, связанных с машинным обучением, линейной алгеброй, статистикой и другими научными или коммерческими задачами.

Признанный лидер

Различия в изначальной постановке задач перед CPU и GPU привели к значительным расхождениям в архитектуре устройств — высокая частота против многоядерности. Для графических процессоров это заложило вычислительный потенциал, который в полной мере реализуется в настоящее время. Видеопроцессоры с внушительным количеством более слабых вычислительных ядер отлично справляются с параллельными вычислениями. Центральный же процессор, исторически спроектированный для работы с последовательными задачами, остается лучшим в своей области.

Для примера сравним значения в производительности центрального и графического процессора на выполнении распространенной задачи в нейронных сетях — перемножении матриц высокого порядка. Выберем следующие устройства для тестирования:

- CPU. Intel Xeon E5-2680 v4 — 28 потоков с HyperThreading, 2.4 GHZ;

- GPU. NVIDIA GTX 1080 — 2560 CUDA Cores, 1607 Mhz, 8GB GDDR5X.

Используем пример вычисления перемножения матриц на CPU и GPU в Jupyter Notebook:

В коде выше мы измеряем время, которое потребовалось на вычисление матриц одинакового порядка на центральном или графическом процессоре («Время выполнения»). Данные можно представить в виде графика, на котором горизонтальная ось отображает порядок перемножаемых матриц, а вертикальная — Время выполнения в секундах:

Линия графика, выделенная оранжевым, показывает время, которое требуется для создания данных в обычном ОЗУ, передачу их в память GPU и последующие вычисления. Зеленая линия показывает время, которое требуется на вычисление данных, которые были сгенерированы уже в памяти видеокарты (без передачи из ОЗУ). Синяя отображает время подсчета на центральном процессоре. Матрицы порядка менее 1000 элементов перемножаются на GPU и CPU почти за одинаковое время. Разница в производительности хорошо проявляется с матрицами размерами более 2000 на 2000, когда время вычислений на CPU подскакивает до 1 секунды, а GPU остается близким к нулю.

Более сложные и практические задачи эффективнее решаются на устройстве с графическими процессорами, чем без них. Поскольку проблемы, которые решают наши клиенты на оборудовании с GPU, очень разнообразны, мы решили выяснить, какие самые популярные сценарии использования существуют.

Температура GPU

GPU является один из самых горячих компонентов компьютера. Как и центральный процессор, GPU выделяет много тепла и его нужно эффективно отводить. Иначе графический процессор начнет перегреваться, что приведет к снижению производительности, сбоям в работе, перегрузкам компьютера и даже поломке.

Узнать температуру GPU можно с помощью специальных программ. Например, можно использовать , которую мы уже вспоминали. Если в программе GPU-Z перейти на вкладку «Sensors», то можно получить информацию о текучем состоянии видеокарты. Здесь будет указана частота GPU, его загрузка, температура и другие параметры.

Если вы хотите проверить не только температуру GPU, но и температуры других компонентов компьютера, то для этого удобно пользоваться программой . Данная программа отображает температуру, частоты, загрузку и другие параметры сразу для всех компонентов.

После проверки температуры часто возникает вопрос, . Точного ответа на этот вопрос нет, поскольку у разных GPU разный предел температур, которые они могут переносить без последствий. Но, в среднем нормальной температурой графического процессора является

:

- до 55 °C в режиме простоя;

- до 80 °C под нагрузкой;

Если температура вашего GPU выходит за эти пределы, то это можно считать перегревом. В таком случае нужно улучшить охлаждение графического чипа, для того чтобы привести эти значения к норме.

Всем привет GPU это обозначение видеокарты, если быть точнее то графический процессор. Данное слово, ну то есть аббревиатуру часто можно встретить в каких-то характеристиках, ну вот например в характеристиках процессора Intel есть такое понятие как Integrated GPU, что означает встроенная видеокарта. Ну все верно, она реально встроена, видео чип сидит прямо в процессоре, это не новость как бы

То есть вывод мы уже сделали, GPU это видюха

Но что еще важно понимать? Я вот писал, что GPU встречается в характеристиках, все верно, по помимо этого также можно встретить и в программах, которые показывают температуру. Я думаю что вы такие проги знаете.

Ну или не знаете, короче в любом случае, то что я сейчас напишу, то это вам будет полезно знать. Значит речь идет про температуру GPU. Многие уверяют, что видюха может работать и при 80 градусах, а вот я заявляю что это слишком высокая температура! Да и вообще я считаю что выше 70 это не норма!

Кстати GPU расшифровывается как Graphics Processing Unit

А вот и сам графический чип, ну то есть GPU, вот я его стрелочками указал на плате:

Но какая тогда норм температура? До 60 градусов, ну максимум 66, ну 70 градусов это уже потолок… Но выше я думаю что это уже не оч хорошо, просто срок службы точно не продлит такая температура, согласны со мной? Ну и еще есть интересный момент, короче если видюха прилично греется, то блин она еще и выкидывает свое тепло в корпус, ну в нем явно не будет прохладно, а тут и процессу станет жарко, короче веселуха! Помните, что именно ТЕМПЕРАТУРА способна снизить срок работы устройства! Вот на старых материнках от высокой температуры взрывались электролитические конденсаторы.. Если не верите, то можете сами посмотреть в интернете..

CPU и GPU очень похожи между собой. Они оба сделаны из миллионов транзисторов, способны совершать тысячи операций в секунду, поддаются . Но в чем разница между CPU и GPU

?

Часто задаваемые вопросы

В чём разница между графической картой и графическим драйвером?

Графическая карта – это физическая часть оборудования, предназначенная для ускорения графических процессов.

Графический драйвер – это «небольшая» программа, которая позволяет вашей операционной системе использовать графическую карту. Графический драйвер содержит инструкции о том, как «управлять» графической картой.

Важна ли видеокарта для редактирования видео на ПК?

В зависимости от сложности ваших проектов мощная видеокарта может ускорить многие этапы работы по редактированию видео.

Программное обеспечение, такое как Premiere Pro и Davinci Resolve, эффективно использует мощные видеокарты.

Какая графическая карта лучше – NVIDIA или AMD?

Выбор лучший графической карты зависит от вашей рабочей нагрузки.

Nvidia часто лидирует в рендеринге и профессиональных рабочих нагрузках, в то время как AMD считается лучшим предложением, особенно для игр, по соотношению производительности на рубль.

Рождение GPGPU

Мы все привыкли думать, что единственным компонентом компа, способным выполнять любой код, который ему прикажут, является центральный процессор. Долгое время почти все массовые ПК оснащались единственным процессором, который занимался всеми мыслимыми расчетами, включая код операционной системы, всего нашего софта и вирусов.

Позже появились многоядерные процессоры и многопроцессорные системы, в которых таких компонентов было несколько. Это позволило машинам выполнять несколько задач одновременно, а общая (теоретическая) производительность системы поднялась ровно во столько раз, сколько ядер было установлено в машине. Однако оказалось, что производить и конструировать многоядерные процессоры слишком сложно и дорого. В каждом ядре приходилось размещать полноценный процессор сложной и запутанной x86-архитектуры, со своим (довольно объемным) кэшем, конвейером инструкций, блоками SSE, множеством блоков, выполняющих оптимизации и т.д. и т.п. Поэтому процесс наращивания количества ядер существенно затормозился, и белые университетские халаты, которым два или четыре ядра было явно мало, нашли способ задействовать для своих научных расчетов другие вычислительные мощности, которых было в достатке на видеокарте (в результате даже появился инструмент BrookGPU, эмулирующий дополнительный процессор с помощью вызовов функций DirectX и OpenGL).

Графические процессоры, лишенные многих недостатков центрального процессора, оказались отличной и очень быстрой счетной машинкой, и совсем скоро к наработкам ученых умов начали присматриваться сами производители GPU (а nVidia так и вообще наняла большинство исследователей на работу). В результате появилась технология nVidia CUDA, определяющая интерфейс, с помощью которого стало возможным перенести вычисление сложных алгоритмов на плечи GPU без каких-либо костылей. Позже за ней последовала ATi (AMD) с собственным вариантом технологии под названием Close to Metal (ныне Stream), а совсем скоро появилась ставшая стандартом версия от Apple, получившая имя OpenCL.

GPU — наше все?

Несмотря на все преимущества, техника GPGPU имеет несколько проблем. Первая из них заключается в очень узкой сфере применения. GPU шагнули далеко вперед центрального процессора в плане наращивания вычислительной мощности и общего количества ядер (видеокарты несут на себе вычислительный блок, состоящий из более чем сотни ядер), однако такая высокая плотность достигается за счет максимального упрощения дизайна самого чипа.

В сущности основная задача GPU сводится к математическим расчетам с помощью простых алгоритмов, получающих на вход не очень большие объемы предсказуемых данных. По этой причине ядра GPU имеют очень простой дизайн, мизерные объемы кэша и скромный набор инструкций, что в конечном счете и выливается в дешевизну их производства и возможность очень плотного размещения на чипе. GPU похожи на китайскую фабрику с тысячами рабочих. Какие-то простые вещи они делают достаточно хорошо (а главное — быстро и дешево), но если доверить им сборку самолета, то в результате получится максимум дельтаплан. Поэтому первое ограничение GPU — это ориентированность на быстрые математические расчеты, что ограничивает сферу применения графических процессоров помощью в работе мультимедийных приложений, а также любых программ, занимающихся сложной обработкой данных (например, архиваторов или систем шифрования, а также софтин, занимающихся флуоресцентной микроскопией, молекулярной динамикой, электростатикой и другими, малоинтересными для линуксоидов вещами).

Вторая проблема GPGPU в том, что адаптировать для выполнения на GPU можно далеко не каждый алгоритм. Отдельно взятые ядра графического процессора довольно медлительны, и их мощь проявляется только при работе сообща. А это значит, что алгоритм будет настолько эффективным, насколько эффективно его сможет распараллелить программист. В большинстве случаев с такой работой может справиться только хороший математик, которых среди разработчиков софта совсем немного.

И третье: графические процессоры работают с памятью, установленной на самой видеокарте, так что при каждом задействовании GPU будет происходить две дополнительных операции копирования: входные данные из оперативной памяти самого приложения и выходные данные из GRAM обратно в память приложения. Нетрудно догадаться, что это может свести на нет весь выигрыш во времени работы приложения (как и происходит в случае с инструментом FlacCL, который мы рассмотрим позже).

Но и это еще не все. Несмотря на существование общепризнанного стандарта в лице OpenCL, многие программисты до сих пор предпочитают использовать привязанные к производителю реализации техники GPGPU. Особенно популярной оказалась CUDA, которая хоть и дает более гибкий интерфейс программирования (кстати, OpenCL в драйверах nVidia реализован поверх CUDA), но намертво привязывает приложение к видеокартам одного производителя.

Что есть сейчас?

В силу своей молодости, а также благодаря описанным выше проблемам, GPGPU так и не стала по-настоящему распространенной технологией, однако полезный софт, использующий ее возможности, существует (хоть и в мизерном количестве). Одними из первых появились крэкеры различных хэшей, алгоритмы работы которых очень легко распараллелить. Также родились мультимедийные приложения, например, кодировщик FlacCL, позволяющий перекодировать звуковую дорожку в формат FLAC. Поддержкой GPGPU обзавелись и некоторые уже существовавшие ранее приложения, самым заметным из которых стал ImageMagick, который теперь умеет перекладывать часть своей работы на графический процессор с помощью OpenCL. Также есть проекты по переводу на CUDA/OpenCL (не любят юниксоиды ATi) архиваторов данных и других систем сжатия информации. Наиболее интересные из этих проектов мы рассмотрим в следующих разделах статьи, а пока попробуем разобраться с тем, что нам нужно для того, чтобы все это завелось и стабильно работало.

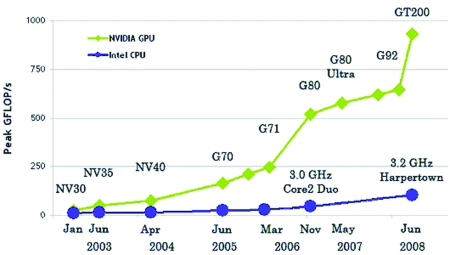

GPU уже давно обогнали x86-процессоры в производительности

GPU уже давно обогнали x86-процессоры в производительности

Во-первых, понадобится видеокарта, поддерживающая технологию CUDA или Stream. Необязательно, чтобы она была топовая, достаточно только, чтобы год ее выпуска был не менее 2009. Полный список поддерживаемых видюшек можно посмотреть в Википедии: en.wikipedia.org/wiki/CUDA и en.wikipedia.org/wiki/AMD_Stream_Processor. Также о поддержке той или иной технологии можно узнать, прочитав документацию, хотя в большинстве случаев будет достаточным взглянуть на коробку из под видеокарты или ноутбука, обычно на нее наклеены различные рекламные стикеры.

Во-вторых, в систему должны быть установлены последние проприетарные драйвера для видеокарты, они обеспечат поддержку как родных для карточки технологий GPGPU, так и открытого OpenCL.

И в-третьих, так как пока дистрибутивостроители еще не начали распространять пакеты приложений с поддержкой GPGPU, нам придется собирать приложения самостоятельно, а для этого нужны официальные SDK от производителей: CUDA Toolkit или ATI Stream SDK. Они содержат в себе необходимые для сборки приложений заголовочные файлы и библиотеки.

Идеальная температура графического процессора

Современные игры требуют, чтобы ваш графический процессор работал с высокой интенсивностью, поскольку они созданы специально для обеспечения высококачественной производительности и несут большую ответственность, когда требуются ресурсы.

Вам может быть интересно узнать, что температура графического процессора напрямую связана с разрешением, с которым ваш дисплей выводит изображения. Чем выше запрошенное разрешение, тем больше пикселей необходимо отобразить и тем больше вычислений требуется графическому процессору.

Любопытно, что температура графического процессора также может быть ограничена вашим географическим положением. По логике вещей, если вы играете в тропическом климате, а не, например, в Исландии, вы столкнетесь с более высокими температурами графического процессора, и вам придется больше инвестировать в решения для охлаждения.

Эти цифры зависят от конкретного графического процессора, но в целом максимальная температура, при которой может работать графический процессор NVIDIA, составляет около отметки 95-100 градусов Цельсия (~ 200-210 градусов по Фаренгейту).

Тем не менее, ваш GPU, работающий при таких температурах, абсолютно не рекомендуется. Если ваша карта приближается к этим уровням нагрева, это считается перегревом. Память и тактовые частоты ядра начнут падать, что также приведет к ухудшению FPS в вашей игре.

С другой стороны, верхний предел карт AMD аналогичен диапазону NVIDIA и составляет около 90-100 градусов Цельсия (~ 165-185 градусов по Фаренгейту).

Тем не менее, циркулирует некоторая информация о том, что безопасная температура (до теплового дросселирования) для серии RX 6000 составляет около 110 градусов по Цельсию.

Оптимальный диапазон для NVIDIA составляет от 70 до 85 градусов по Цельсию (~158-185 по Фаренгейту), в то время как AMD лучше всего работает при температуре от 60 до 70 по Цельсию (~140-158 по Фаренгейту).

Встроенный GPU

Интегрированная видеокарта располагается на материнской плате или в процессоре. То, что это GPU в компьютере, не означает, что надо запускать требовательные игры или фильмы в высоком качестве. Дело в том, что видеокарты данного типа рассчитаны на работу с простыми приложениями, которые не требуют больших ресурсов. К тому же они не потребляют большое количество энергии.

Что касается объема памяти, то интегрированное GPU в компьютере использует для работы объем и частоты оперативной памяти.

Большинство пользователей используют карты данного типа только для того, чтобы установить драйвера на дискретную видеокарту.

Что такое GPU?

GPU (Graphics Processing Unit или же Графическое Процессорное Устройство) представляет собой специализированный тип микропроцессора, оптимизированный для очень специфических вычислений и отображения графики. Графический процессор работает на более низкой тактовой частоте в отличие от процессора, но имеет намного больше процессорных ядер.

Также можно сказать, что GPU — это специализированный CPU, сделанный для одной конкретной цели — рендеринг видео. Во время рендеринга графический процессор огромное количество раз выполняет несложные математические вычисления. GPU имеет тысячи ядер, которые будут работать одновременно. Хоть и каждое ядро графического процессора медленнее ядра центрального процессора, это все равно эффективнее для выполнения простых математических вычислений, необходимых для отображения графики. Этот массивный параллелизм является тем, что делает GPU способным к рендерингу сложной 3D графики, требуемой современными играми.

Как работает процессор

GPU занимается обработкой

2D и 3D графики. Благодаря GPU ЦП компьютера становится свободнее и может выполнять более важные задачи. Главная особенность графического процессора в том, что он старается максимально увеличить скорость

расчета графической информации. Архитектура чипа позволяет с большей эффективностью

обрабатывать графическую информацию, нежели центральный CPU ПК.

Графический процессор устанавливает расположение

трехмерных моделей в кадре. Занимается фильтрацией

входящих в них треугольников, определяет, какие находятся на виду, и отсекает те, которые скрыты другими объектами.

CPU и GPU очень похожи между собой. Они оба сделаны из миллионов транзисторов, способны совершать тысячи операций в секунду, поддаются . Но в чем разница между CPU и GPU

?

Как узнать температуру видеокарты в Windows 10

В операционной системе Windows 10 имеется встроенная функция мониторинга производительности компьютера. Благодаря этому, температура видеокарты в Windows 10 показана в том состоянии, которое имеется в данный момент времени.

Необходимые сведения о состоянии графической подсистемы находятся в Диспетчере задач. Пользователю нужно сделать несколько несложных действий, чтобы получить нужную информацию.

Пройдите следующие шаги:

- Щелкните правой кнопкой мыши по Панели задач.

- В контекстном меню нажмите на пункт «Диспетчер задач».

- В окне «Диспетчер задач» откройте вкладку «Производительность».

- Прокрутите колесико мыши в левой колонке вниз, нажмите на элемент «Графический процессор».

На некоторых компьютерах может быть два видеоадаптера: встроенная графика и дискретная видеокарта. В данном случае, на этом компьютере имеется графической ускоритель от Intel, встроенный в материнскую плату, и отдельный видеоадаптер NVIDIA, подключенный к системной плате.

- В окне отображаются графики работы графического процессора, а среди прочих характеристик отображена температура GPU.

Что такое GPU в компьютере

Аббревиатура GPU расшифровывается как Graphics Processing Unit, что можно перевести как устройство для обработки графики. Фактически GPU именно этим и является это отдельный модуль компьютера, который отвечает за обработку графики. В компьютере GPU может быть выполнен как отдельный кремниевый чип, который распаян на материнской или собственной отдельной плате (видеокарте), либо как часть центрального процессора или чипсета (северный мост).

Как выглядит GPU в компьютере.

Если GPU выполнен в качестве отдельного чипа, то его обычно называет графическим процессором, а если GPU является частью центрального процессора или чипсета, то часто для его обозначения используется термин интегрированная графика или встроенная графика.

В некоторых случаях под термином GPU понимают видеокарту, что не совсем верно, поскольку GPU – это именно чип (графический процессор), который занимается обработкой графики, а видеокарта — это целое устройство ответственное за обработку графики. Видеокарта состоит из графического процессора, памяти, имеет собственную плату и BIOS.

Другими словами, GPU – это графический процессор, который представляет собой кремниевый чип, на отдельной плате (видеокарте). Также под GPU может пониматься модуль, встроенный в центральный процессор (основной чип компьютера). В обоих случаях GPU занимается обработкой графики.

В современных условиях GPU часто используется не только для обработки графики, но и для решения других задач, которые могут быть обработаны с помощью графического процессора более эффективно, чем с помощью центрального процессора. Например, GPU используют для кодирования видео, машинного обучения, научных расчетов.

Выводы статьи

Необходимо следить за состоянием аппаратного обеспечения компьютера для профилактики от преждевременного выхода из строя устройств и компонентов. В процессе работы на ПК, видеокарта очень сильно нагревается при выполнении ресурсоемких задач или в играх. Для мониторинга нагрева видеоадаптера используются программы, показывающие значения температуры в режиме реального времени.

Как узнать температуру видеокарты (видео)

Похожие публикации:

- Как узнать какая оперативная память стоит на компьютере: 7 способов

- Как узнать модель материнской платы — 7 способов

- Как изменить дату создания файла — 5 способов

- Как посмотреть сколько ядер у процессора — 7 способов

Выводы

Главный чип на материнской плате – это центральный процессор (CPU – Central Processor Unit). Центральный, потому что управляет всеми остальными подсистемами, с помощью системы шин и чипсета.

Подсистема, которая управляет визуализацией и выводом информации на экран называется видеосистемой. Она интегрируется в материнскую плату через слот в виде видеокарты. Видеокарта – инженерное решение и представляет собой плату с собственным процессором (тем самым GPU) и оперативной памятью.

GPU NVidia Nv45 на видеокарте

Процессор на видеокарте называют GPU (Graphic Processor Unit), чтобы подчеркнуть:

- Что это процессор.

- Что он не центральный, то есть подчиненный для CPU.

- Что он ориентирован на обработку специальных данных – графики.

Расположение GPU на материнской плате

Поскольку обработка графики – это специализация в обработке данных, GPU – это специализированный CPU. Логически специализация выражается отделением GPU от CPU, физически – тем, что GPU устроен иначе.

CPU содержит десятки ядер, GPU — тысячи

Такая физическая реализация GPU обоснована необходимостью обрабатывать тысячи параллельных задач, связанных с отрисовкой. Центральный процессор ориентирован на обработку данных – долгие и последовательные задачи.

Современный ЦП (CPU) может включать в себя графический процессор.

Четрыехядерный процессор с дополнительным графическим ядром GPU

Такое решение позволяет компьютеру обойтись без видеокарты за счет встроенного в центральный процессор GPU. Это снижает потребляемую энергию от 30 до 180%. Стоимость процессора при этом возрастает не более чем на 20%.

Главный минус такой реализации – низкая производительность. Такое решение подходит для офисных компьютеров, где работают с документами и базами данных, но современную компьютерную игру на нем не запустишь, Фотошоп будет притормаживать, а Автокад может зависнуть намертво.

Как узнать GPU в компьютере

Для пользователя GPU прочно ассоциируется с видеокартой, хотя это только процессор. Знать, какой графический адаптер установлен в компьютере полезно в трех случаях:

- при установке или обновлении драйверов;

- при оценке компьютера на соответствие системным требованиям программного обеспечения;

- чтобы хвастаться перед друзьями.

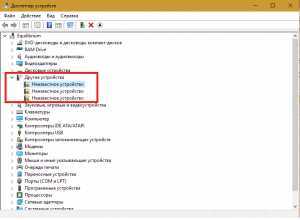

Ели на компьютере установлены все драйвера, то самый быстры способ – посмотреть в диспетчере устройств, в разделе видеоадаптеры:

Просмотр GPU в диспетчере устройств

Если драйвера не установлены диспетчер устройств покажет только надпись о неизвестных устройствах:

GPU в диспетчере устройств в случае отсутствия драйверов

В этом случае скачайте утилиту CPU-Z, запустите и перейдите на вкладку «Графика» (Graphics в англ. версии):

Просмотр GPU в программе CPU-Z

helpadmins.ru